Top-News

News | Business | Favoriten der Redaktion | Geschäftsprozesse | IT-Security | Kommunikation | Services

Die Einhaltung von NIS2 wird nicht an der Technik scheitern, sondern an den Menschen

NIS2 erhöht die Erwartungen an die Cybersicherheit in ganz Europa und stellt das menschliche Verhalten in den Mittelpunkt der Compliance – Experten für Human Risk Management fordern Unternehmen auf ihre Belegschaft auf NIS2 vorbereiten. NIS2 hat die Messlatte für die Cybersicherheit in ganz Europa höher gelegt, und das aus gutem Grund. Die Bedrohungen sind hartnäckiger,…

News | Trends 2025 | Trends Security | IT-Security | Tipps

Studie legt die schwerwiegendsten Datenlecks im Jahr 2025 offen

Nur eine Handvoll großer Datenlecks haben das Cybersicherheitsjahr 2025 geprägt – sie überstrahlten mit ihrem Ausmaß und ihren Folgen tausende kleinere Vorfälle bei weitem. Die Expertenteams von NordPass und Nord Stellar haben die bedeutendsten Datenpannen und -lecks zusammengetragen, die sie beobachtet haben. Hier sind die fünf größten Datenlecks – gemessen an der Anzahl der offengelegten Zugangsdaten…

News | Business | Business Process Management | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | Strategien | Tipps

Das Wikipedia‑Verbot für KI‑Texte ist ein Weckruf für Unternehmen

Datenökologie, Governance und strategische Risiken im Zeitalter generativer KI Das Wikipedia‑Verbot für KI‑Texte ist weniger ein KI‑Problem als vielmehr ein Signal für die Bedeutung stabiler unternehmensinterner Datenökosysteme. Model Collapse und »Habsburg AI« sind reale Risiken, entstehen jedoch nicht automatisch, sondern vor allem durch fehlende Daten‑Governance und unkontrollierten Einsatz synthetischer Inhalte. Die zentrale Botschaft…

News | Business | Digitalisierung | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | New Work | Strategien

Model Collapse und Datenökologie: Warum die englischsprachige Wikipedia KI‑generierte Artikeltexte untersagt

Abstract Die englischsprachige Wikipedia hat den Einsatz großer Sprachmodelle (LLMs) zum Generieren oder Umschreiben von Artikelinhalt untersagt und nur eng begrenzte Ausnahmen für Copyediting eigener Texte sowie Übersetzungsunterstützung zugelassen. Diese Entscheidung lässt sich nicht allein als redaktionelles Qualitätsinstrument verstehen, sondern als datenökologischer Eingriff in ein globales Trainingsdaten‑Ökosystem, das zunehmend durch synthetische Inhalte geprägt wird. Zentraler…

News | Business | Digitalisierung | Favoriten der Redaktion | Kommentar | Künstliche Intelligenz | Strategien | Tipps

Warum Wikipedia den Einsatz generativer KI einschränkt: Habsburg KI als datenökologisches Risiko

Die Entscheidung der englischsprachigen Wikipedia, den Einsatz großer Sprachmodelle (Large Language Models, LLMs) zum Schreiben oder Umschreiben von Artikeln weitgehend zu untersagen, markiert einen Wendepunkt im gesellschaftlichen Umgang mit generativer künstlicher Intelligenz. Auf den ersten Blick wirkt das Verbot paradox: Gerade LLMs sind in der Lage, formal korrekte, gut strukturierte und enzyklopädisch anmutende Texte zu…

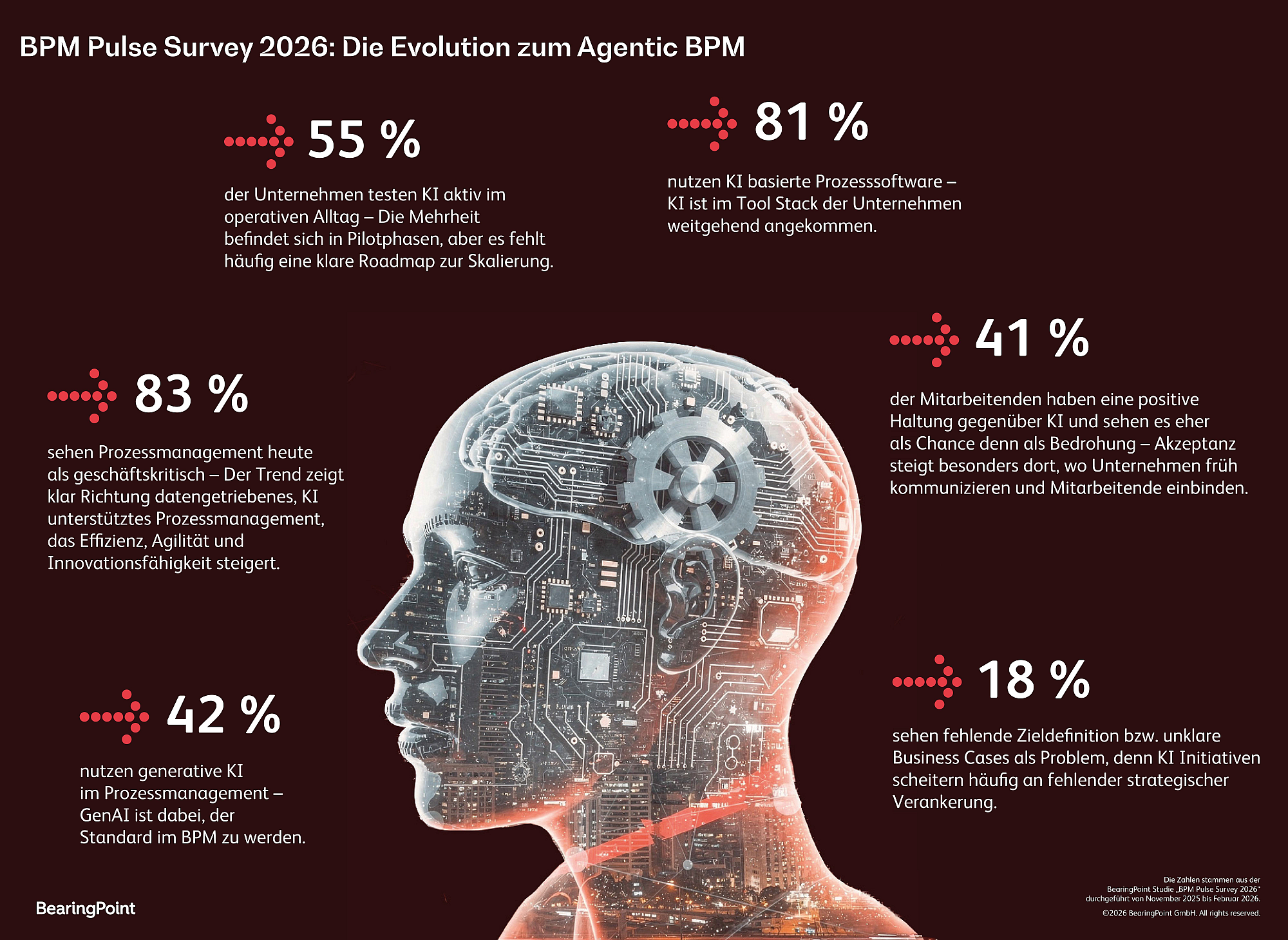

News | Trends 2026 | Business | Trends Wirtschaft | Favoriten der Redaktion | Künstliche Intelligenz | New Work | Whitepaper

KI sorgt häufiger für Beschäftigungswachstum als für Stellenabbau

Viele Unternehmen melden Beschäftigungswachstum durch KI. Der Einsatz von künstlicher Intelligenz geht in deutschen Unternehmen häufiger mit Beschäftigungswachstum als mit Stellenabbau einher. Zu diesem Ergebnis kommt eine neue globale Studie von Snowflake, dem AI Data Cloud-Unternehmen, die in Zusammenarbeit mit dem Marktforschungsunternehmen Omdia veröffentlicht wurde. Für die Studie »The ROI of Gen AI and Agents«…

News | Business Process Management | Effizienz | Favoriten der Redaktion | Geschäftsprozesse | Künstliche Intelligenz | Strategien | Tipps

KI beginnt mit Vertrauen: Daten-Governance als Schlüssel zwischen Strategie und messbaren Resultaten

Der Erfolg von KI hängt weniger von Modellen als von vertrauenswürdigen, geschäftlich nutzbaren Daten ab, weshalb viele Initiativen an fehlender Daten‑Governance scheitern. Moderne Daten‑Governance wird dabei als Enabler verstanden, der Klarheit, Verantwortlichkeiten und Datenqualität schafft und KI so skalierbar und wirksam macht. Entscheidend ist ein dynamischer Data‑First‑Ansatz, der Governance als kontinuierliches Change Management etabliert und…